Google已开始部署Gemini创新的实时AI视频功能,从而使平台能够从用户设备显示器或智能手机的相机中解释视觉输入并提供上下文答案。

确认此部署在最初的“ Astra Project Astra”演示的近一年后,为这些功能提供动力的基础技术是

。

报告

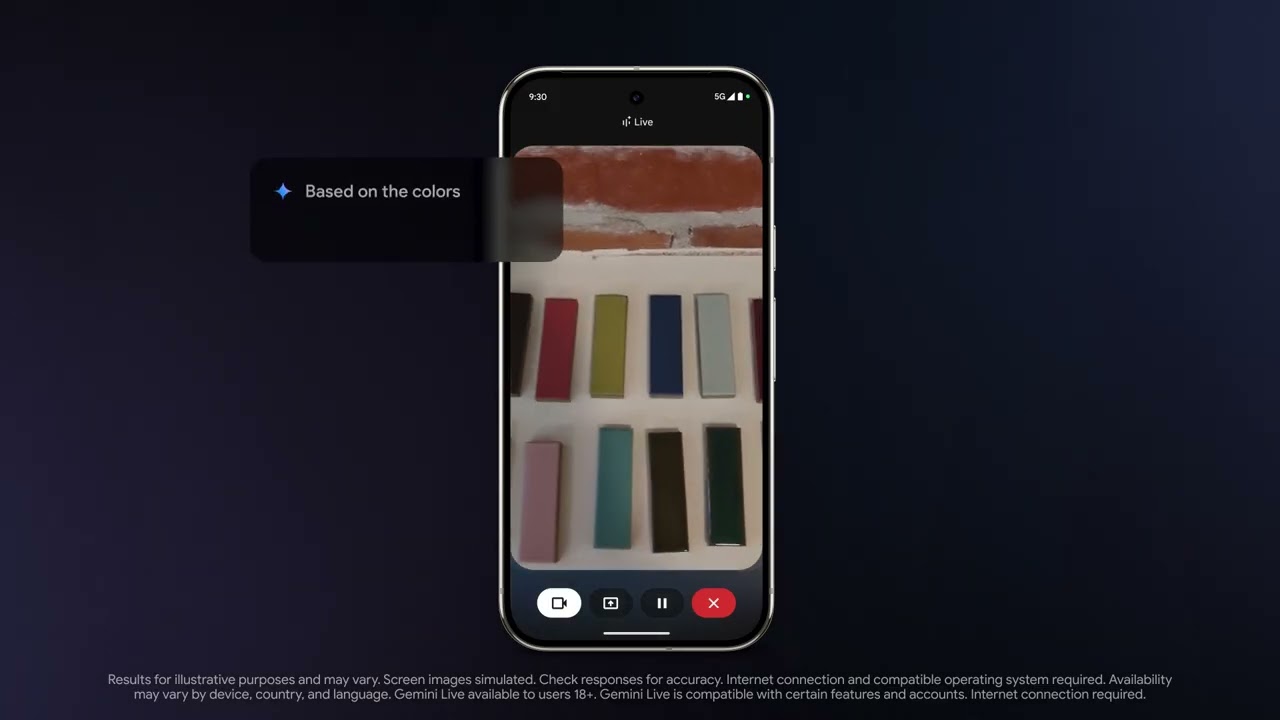

reddit用户,最初在小米手机上显示了此功能的外观。此用户随后分享了一个视频,展示了双子座分析屏幕内容的新能力。该屏幕阅读功能是Google在3月初宣布的两个关键功能之一,将通过Google One A One AI Premium计划在同月晚些时候逐步提供给Gemini高级订户。

第二个功能宣布使用智能手机的相机处理实时视频提要,从而使双子座能够理解并回答有关用户周围环境的问题。

此更新是在最近引入双子座的

,它可以帮助用户写作和编码任务,并添加播客摘要工具。与Apple,Samsung甚至亚马逊相比,该更新与Gemini Live视频相结合,实际上仅显示了Google现在在AI助手技术方面的领先地位。

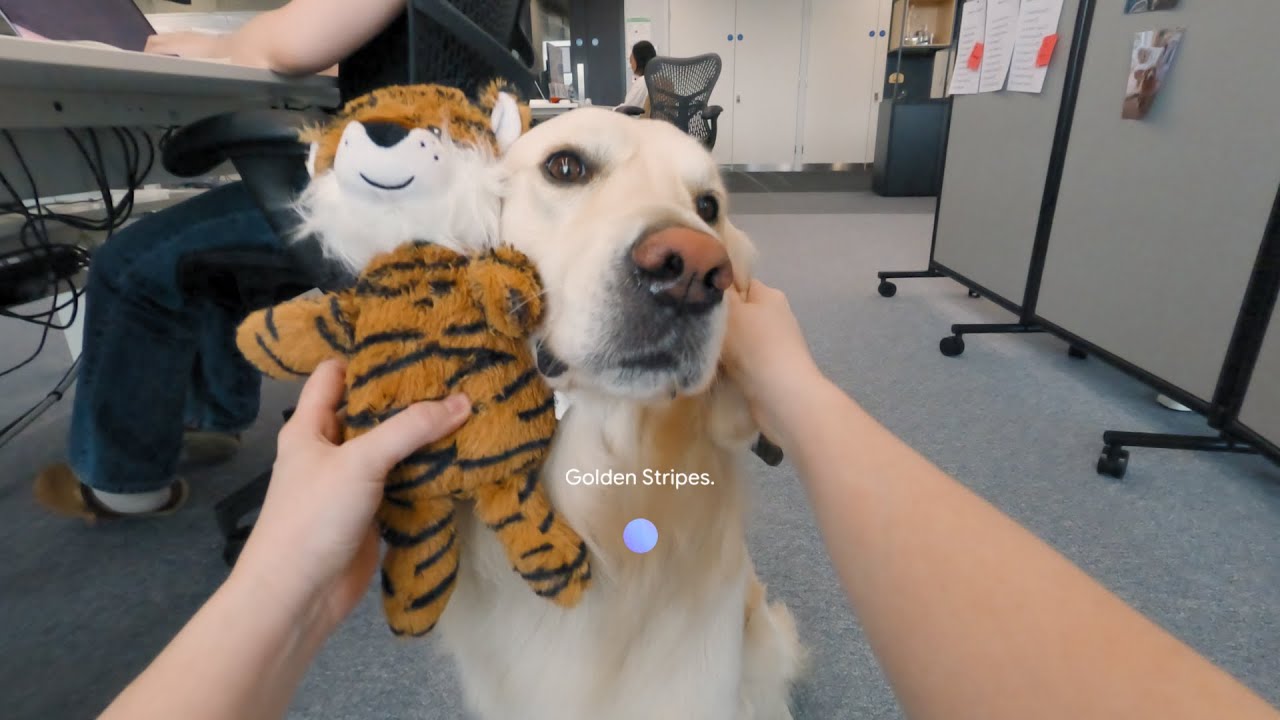

当然,这似乎并没有涵盖Astra Project Project的每个方面,因为它去年被演示,并且可以在上面的视频中看到。完整的演示展示了助手保留了通过相机看到的物品的记忆,并稍后告诉您它看到的位置 - 甚至让您可以选择借鉴物品,以询问有关圈出区域的更多特定信息。

但是,对我来说,感觉我们与去年的AI助手未来相距不远。双子座在其功能集中进步的速度非常有前途,我很高兴看到Google如何在今年的Google I/O会议上排名最高。